複製テスト

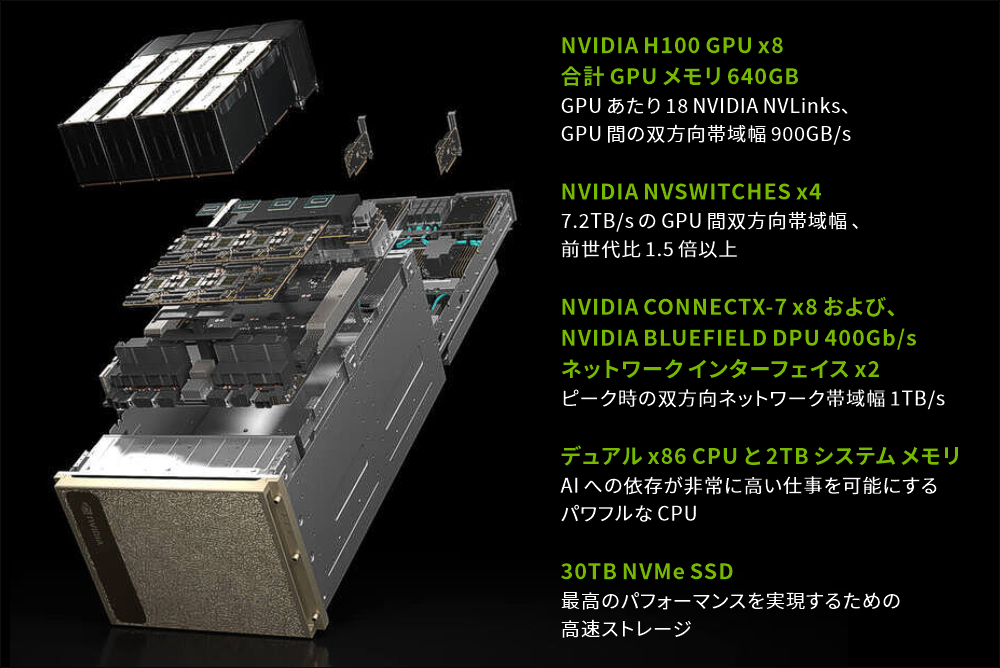

NVIDIA H100 GPU 8基搭載

エンタープライズ AI システム

- Intel 3rd Gen Xeon Scalable

- Intel 4th Gen Xeon Scalable

- 32GB GDDR6 Memory

- 40GB HBM2 Memory

- 12BAY

- 14BAY

- MAX 8GPU

NVIDIA DGX H100 : エンタープライズ AI システム

第4世代 NVIDIA DGX H100 は NVIDIA H100 Tensor Core GPU を搭載した AI システムです。AI のスループットを最大化するように設計されており、システム化され、高度に洗練された拡張可能なプラットフォームを企業に提供することで、自然言語処理・レコメンドシステム・データ分析など様々な分野を支援します。また、完全に最適化されたハードウェアとソフトウェアのプラットフォームとして、全ての領域に対しフルサポートされます。そこには、NVIDIA の AI ソフトウェアソリューションやサードパーティ・サポートの豊富なエコシステム、NVIDIA プロフェッショナルサービスによる専門家のアドバイスなどが含まれます。

詳しくは担当までお問い合わせください。

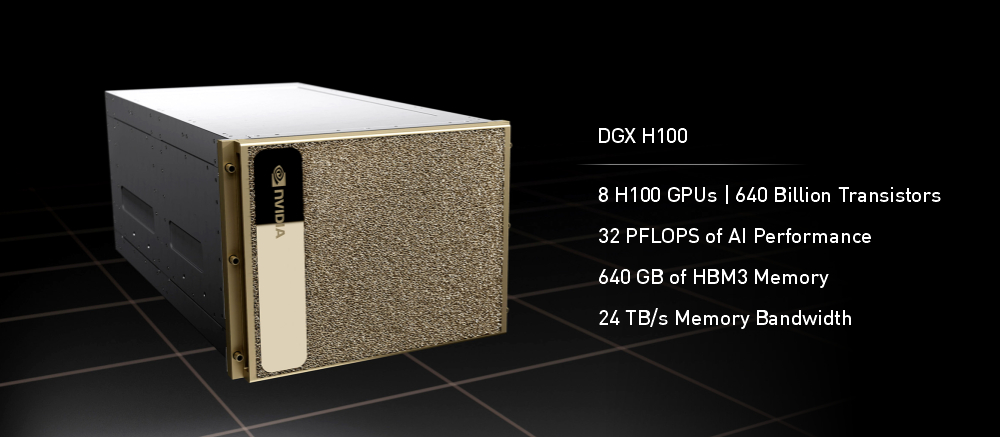

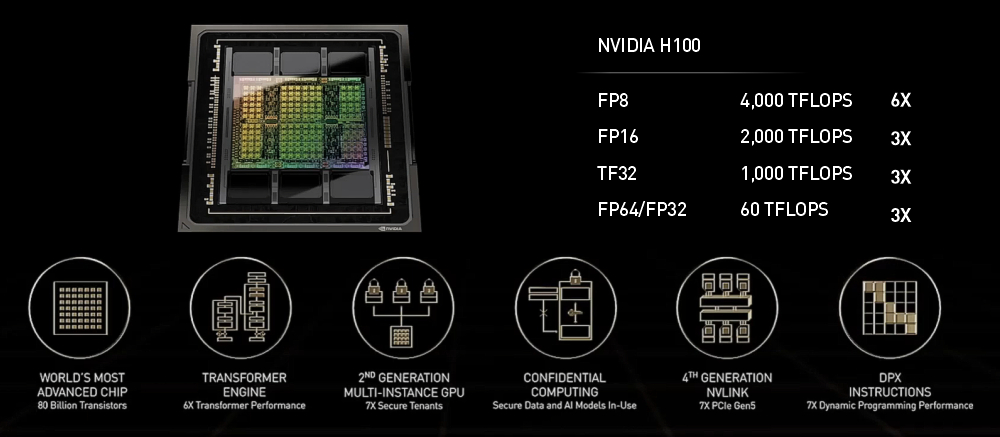

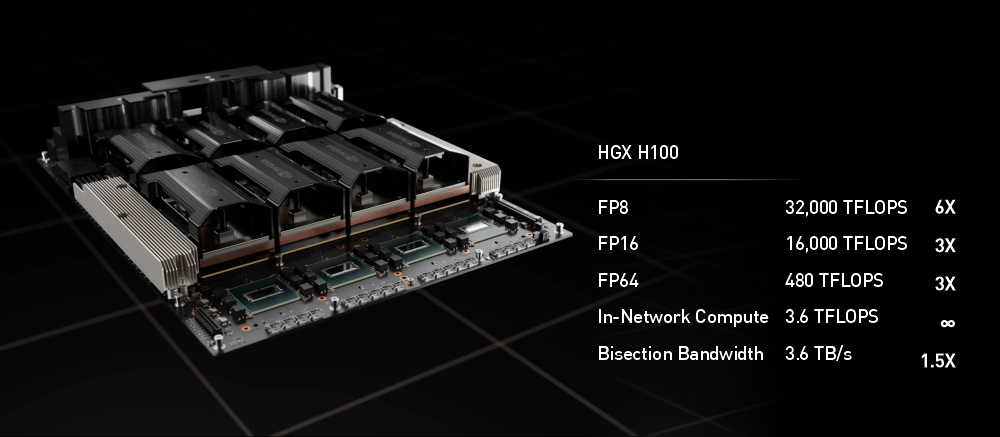

Hopperアーキテクチャ NVIDIA H100 GPU を 8基搭載

32petaFLOPS の FP8パフォーマンスを誇る AIプラットフォーム

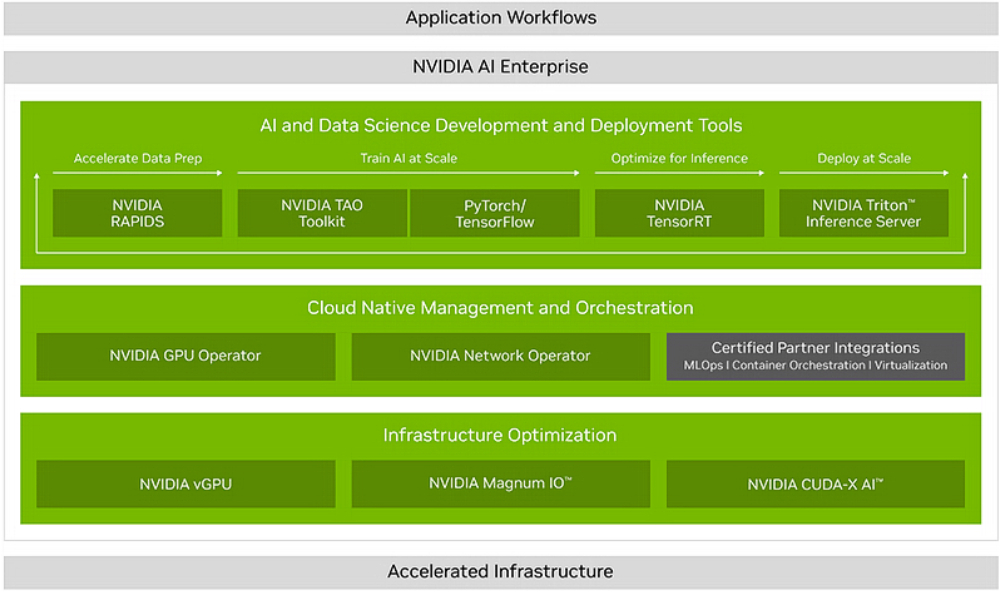

NVIDIA AI Enterprise – AI Enterprise ソフトウェア スイート

AI の開発と展開に最適化された、クラウドネイティブな AI およびデータ分析ソフトウェア スイートで、企業における AI 導入の体制を整えましょう。NVIDIA AI Enterprise は、対話型 AI 用 NVIDIA® Riva、レコメンダー用 NVIDIA Merlin™、医用画像処理用 NVIDIA Clara™ など、豊富なフレームワークで構成されたライブラリで構築されたアプリケーションに不可欠な、NVIDIA AI プラットフォームのオペレーティング システムです。

DGX ソフトウェアバンドルには、合理化された AI 開発および展開のための NVIDIA AI Enterprise と、エンタープライズサポートが含まれています。

AI の価値を短期間で引き出す。

AI 実務者のための業界最高水準の開発ツールとフレームワーク、および IT 専門家のための信頼できる管理とオーケストレーションにより、優れた処理能力、可用性、セキュリティを確保します。

NVIDIA DGX H100 : SYSTEM SPECIFICATIONS

| NVIDIA DGX H100 | NVIDIA DGX A100 | |

|---|---|---|

| GPU | NVIDIA H100 Tensor Core GPU 80GB x8 |

NVIDIA A100 Tensor Core GPU 80GB x8 |

| GPU Memory | 640GB total | 640GB total |

| Performance | 32 petaFLOPS FP8 | 5petaFLOPS AI 10petaOPS INT8 |

| NVIDIA NVSwitches | 4 | 6 |

| System Power Usage | ~10.2kW max | 6.5kW max |

| CPU | Dual x86 | Dual AMD rome 7742 (128Core Total, 2.25GHz) |

| System Memory | 2TB | 2TB |

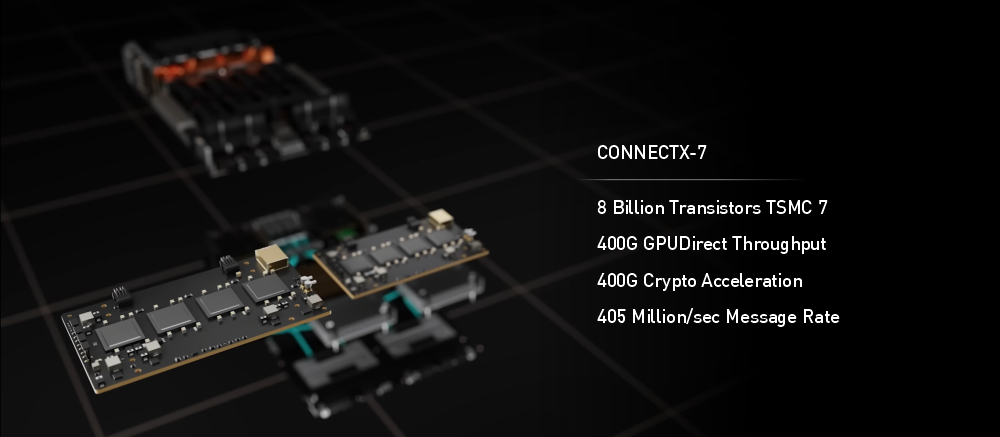

| Networking | 4x OSFP ports serving 8x single-port NVIDIA ConnectX-7 VPI 400 Gb/s InfiniBand or 200 Gb/s Ethernet2x dual-port NVIDIA ConnectX-7 VPI 1x 400 Gb/s InfiniBand 1x 200 Gb/s Ethernet |

8x Single-Port Mellanox ConnectX-6 VPI 200Gb/s HDR InfiniBand 2x Dual-Port Mellanox ConnectX-6 VPI 10/25/50/100/200 Gb/s Ethernet |

| Management network | 10 Gb/s onboard NIC with RJ45 50 Gb/s Ethernet optional NIC Host baseboard management controller (BMC) with RJ45 |

|

| Storage | OS: 2x 1.9TB NVMe M.2 Internal storage: 8x 3.84TB NVMe U.2 |

OS : 2x 1.92TB M.2 NVMe Drives Internal Storage : 30TB (8x 3.84TB) U.2 NVMe Drives |

| Software | NVIDIA AI Enterprise – Optimized AI software NVIDIA Base Command – Orchestration, scheduling, and cluster management Ubuntu / Red Hat Enterprise Linux / CentOS – Operating system |

Ubuntu Linux OS Also supports: Red Hat Enterprise Linux CentOS |

| Support | Comes with 3-year business-standard hardware and software support |

|

| Operating temperature range |

5~30°C |

NVIDIA H100 Tensor Core GPU Architecture V1.04

NVIDIA H100 Tensor Core GPU Architecture V1.04

弊社では、科学技術計算や解析などの各種アプリケーションについて動作検証を行い、

すべてのセットアップをおこなっております。

お客様が必要とされる環境にあわせた最適なシステム構成をご提案いたします。